SageMaker AI: Despliega Inferencia con Capacidad GPU Garantizada

SageMaker AI: Despliega Inferencia con Capacidad GPU Garantizada

Descubre cómo iamanos.com, tu socio experto en IA con estándares globales y sede en CDMX, está redefiniendo el futuro con esta noticia clave. La escasez de cómputo GPU es el cuello de botella más crítico para las empresas que escalan IA en producción hoy. AWS acaba de cambiar las reglas del juego. SageMaker AI ahora permite reservar capacidad GPU con garantía de disponibilidad, y en iamanos.com ya estamos implementando esta arquitectura para nuestros clientes empresariales.

El Problema Real que SageMaker AI Resuelve en 2026

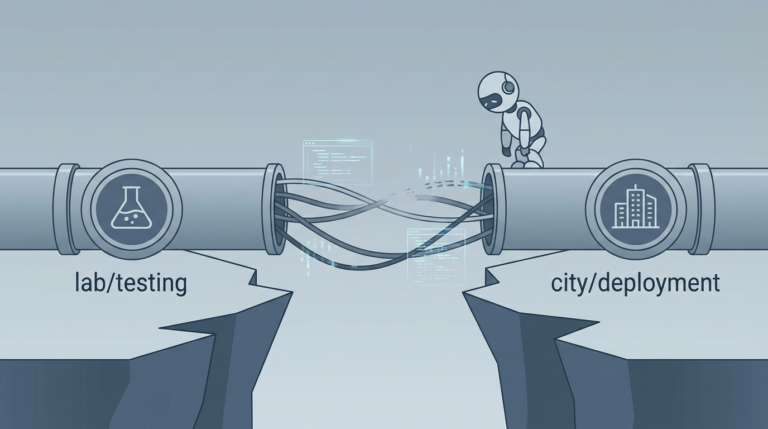

En este 2026, el despliegue de modelos de inteligencia artificial en ambientes de producción enfrenta un obstáculo que ningún director de tecnología puede ignorar: la disponibilidad intermitente de unidades de procesamiento gráfico en la nube. Las empresas que dependen de instancias bajo demanda han experimentado en carne propia los retrasos, los fallos de aprovisionamiento y los costos impredecibles que eso conlleva.

AWS ha documentado esta solución de forma detallada en su blog oficial de Machine Learning, donde explica cómo los planes de entrenamiento ahora pueden redirigirse estratégicamente hacia endpoints de inferencia. Este movimiento representa una maduración crítica de la infraestructura de inteligencia artificial empresarial: pasar del modelo reactivo al modelo proactivo de gestión de recursos.

La pregunta que todo Director de Tecnología debe hacerse hoy no es si necesita capacidad GPU garantizada, sino cuándo su organización pagará el precio de no tenerla. Según estimaciones del sector, para finales de 2026, más del 70% de las cargas de trabajo de IA en producción requerirán acuerdos de capacidad garantizada para cumplir sus acuerdos de nivel de servicio.

Instancias bajo demanda contra capacidad reservada: la diferencia que importa

Cuando una empresa depende de instancias de cómputo bajo demanda para sus modelos en producción, está apostando a que los reclutamiento-gestion-talento/” target=”_blank” rel=”noopener noreferrer”>recursos estarán disponibles exactamente cuando los necesite. En periodos de alta demanda regional —lanzamientos de productos, campañas de marketing masivas, eventos críticos de negocio— esa apuesta puede perderse. La capacidad reservada elimina esa variable. Con los planes de entrenamiento de SageMaker AI redirigidos a inferencia, la empresa paga por una capacidad garantizada que ningún otro cliente puede arrebatarle, independientemente de la demanda global en los centros de datos de AWS.

¿Listo para implementar IA en tu empresa?

Cotiza tu proyecto en menos de 5 minutos

Sin compromiso. Sin tecnicismos. Solo resultados.

La familia de procesadores P y su posición en la jerarquía de cómputo de AWS

Las instancias de la familia P de AWS —específicamente las P3, P4 y P5— representan el nivel más alto de aceleración por procesamiento gráfico disponible en la nube de Amazon. Las instancias P5 están equipadas con procesadores de última generación diseñados para cargas de trabajo de aprendizaje profundo de mayor intensidad. Al reservar estas instancias a través de planes de entrenamiento y redirigirlas a endpoints de inferencia, las organizaciones obtienen acceso consistente a hardware de élite sin los sobrecostos ni la incertidumbre de los mercados de instancias puntuales.

Arquitectura Técnica: Cómo Funciona el Proceso de Despliegue

El completo-desarrollo-ia-2026/” target=”_blank” rel=”noopener noreferrer”>proceso que AWS habilita en SageMaker AI sigue una lógica arquitectónica elegante que todo equipo de ingeniería de IA debe comprender. Los planes de entrenamiento, originalmente diseñados para asegurar capacidad durante fases de entrenamiento de modelos de larga duración, ahora actúan como el mecanismo de reserva que alimenta directamente los endpoints de inferencia.

Paso a paso: del plan de entrenamiento al endpoint de inferencia

El flujo comienza con la creación de un plan de entrenamiento que especifica el tipo de instancia GPU deseado, la cantidad de instancias y el periodo de reserva. Una vez aprobado y activo, el ingeniero de infraestructura puede asociar ese plan directamente al endpoint de inferencia en SageMaker AI. El servicio reconoce la capacidad reservada y prioriza su asignación a ese endpoint sobre cualquier solicitud de instancia bajo demanda. El resultado es un endpoint que siempre tiene los reclutamiento-gestion-talento/” target=”_blank” rel=”noopener noreferrer”>recursos que necesita, con latencias predecibles y sin interrupciones por falta de disponibilidad de hardware.

Configuración de escalabilidad automática con capacidad reservada

Una de las ventajas menos discutidas de esta funcionalidad es su compatibilidad con los mecanismos de escalabilidad automática de SageMaker AI. Las empresas pueden configurar políticas de escalado que respeten los límites de su capacidad reservada, expandiéndose dinámicamente dentro de ese rango sin saltar a instancias bajo demanda no planificadas. Esto transforma la gestión de costos de reactiva a absolutamente predecible: el presupuesto de infraestructura de IA deja de ser una estimación y se convierte en una cifra controlada. Para organizaciones que ya trabajan con automatización de flujos financieros complejos mediante inteligencia artificial, esta previsibilidad de costos es un requisito no negociable.

Compatibilidad con marcos de trabajo de aprendizaje profundo

Los endpoints desplegados bajo este esquema mantienen compatibilidad completa con los marcos de trabajo más utilizados en la industria: TensorFlow, PyTorch, Hugging Face Transformers y otros entornos de inferencia populares. Los equipos no necesitan modificar sus pipelines existentes de empaquetado de modelos. La reserva de capacidad opera a nivel de infraestructura, completamente transparente para las capas de software superiores, lo que reduce drásticamente el tiempo de adopción en organizaciones con stacks tecnológicos ya establecidos.

Impacto Estratégico para Directores de Tecnología en México y Latinoamérica

Esta funcionalidad de SageMaker AI no es un detalle técnico de nicho. Es una decisión de arquitectura empresarial con implicaciones directas en competitividad, costos operativos y capacidad de cumplir compromisos de servicio. En iamanos.com hemos identificado tres vectores de impacto que todo Director de Tecnología debe llevar a su próxima reunión de comité ejecutivo.

Primero: la previsibilidad presupuestaria. Las empresas que operan con instancias bajo demanda enfrentan variaciones de costo de hasta el 40% mensual dependiendo de la disponibilidad y los precios del mercado de instancias puntuales. La capacidad reservada convierte ese gasto variable en un costo fijo planificable. Para organizaciones que ya están explorando cómo implementar inteligencia artificial en sus sistemas de ventas y predicción comercial, la estabilidad de infraestructura es el cimiento sobre el que se construye todo lo demás.

Segundo: los acuerdos de nivel de servicio. Cuando un modelo de inteligencia artificial forma parte de un producto o servicio crítico —atención al cliente automatizada, análisis de riesgo en tiempo real, recomendaciones personalizadas— la disponibilidad del cómputo es tan importante como la precisión del modelo. Un endpoint que falla por falta de instancias disponibles destruye la experiencia del usuario independientemente de cuán sofisticado sea el modelo subyacente.

Tercero: la ventaja competitiva en velocidad de respuesta. Las organizaciones que garantizan inferencia en tiempo real con latencias menores a 100 milisegundos tienen entre 3 y 5 veces más retención de usuarios en aplicaciones de IA conversacional, según datos del sector para 2026. Esta capacidad solo es posible con recursos de cómputo garantizados, no con instancias que compiten en un mercado abierto.

Casos de uso donde la capacidad reservada es indispensable

Existen categorías de aplicación donde operar sin capacidad garantizada es simplemente inaceptable. Los sistemas de detección de fraude en servicios financieros deben procesar cada transacción en milisegundos. Los asistentes de inteligencia artificial en plataformas de atención al cliente —como los que desarrollamos en iamanos.com— deben estar disponibles las 24 horas del día sin excepciones. Los motores de recomendación en plataformas de comercio electrónico durante campañas de alta demanda como el Buen Fin o temporada navideña no pueden depender de que haya instancias disponibles en ese momento preciso. Para profundizar en cómo la IA está rediseñando la atención al cliente a nivel estructural, recomendamos revisar nuestro análisis sobre plataformas de atención al cliente con inteligencia artificial.

Optimización de costos: cuándo reservar y cuándo no

La capacidad reservada no es la respuesta correcta para todas las cargas de trabajo. Los equipos de ingeniería en iamanos.com aplican un marco de decisión claro: si una carga de trabajo de inferencia tiene un patrón predecible y requiere disponibilidad constante, la reserva es obligatoria. Si el patrón es altamente variable e impredecible, con picos esporádicos y largos periodos de baja actividad, las instancias bajo demanda o incluso los modelos de pago por solicitud pueden ser más eficientes. La arquitectura híbrida —capacidad base reservada más escalado bajo demanda para picos— es frecuentemente la respuesta óptima para empresas en crecimiento. Para empresas que están construyendo sus propios productos de software con IA, esta decisión de arquitectura es uno de los temas centrales que abordamos en nuestra guía sobre cómo crear un producto de software con inteligencia artificial en México.

De cara a 2027: La Infraestructura de IA como Ventaja Competitiva Sostenible

El movimiento de AWS con SageMaker AI es una señal inequívoca de hacia dónde se mueve la industria. Las plataformas de nube están evolucionando de proveedoras de cómputo genérico a socias estratégicas en la operación de inteligencia artificial empresarial. La gestión de capacidad GPU ya no es responsabilidad exclusiva del equipo de infraestructura: es una decisión de negocio que impacta directamente en la propuesta de valor de los productos digitales.

Las organizaciones que establezcan sus acuerdos de capacidad reservada en 2026 estarán en una posición significativamente mejor cuando la demanda de cómputo para IA continúe su crecimiento acelerado de cara a 2027. Como hemos analizado en profundidad en nuestro reporte sobre la demanda energética que la IA está imponiendo a las redes eléctricas globales, la presión sobre los recursos de cómputo físico no va a disminuir. La escasez estructural de silicio de alto rendimiento hace que asegurar capacidad hoy sea una decisión estratégica, no solo operativa.

En iamanos.com acompañamos a empresas mexicanas y latinoamericanas en la definición de sus estrategias de infraestructura para inteligencia artificial, desde la selección de la plataforma correcta hasta la negociación de los planes de capacidad que mejor se ajustan a sus proyecciones de crecimiento. La diferencia entre una empresa que escala su IA con confianza y una que lucha contra interrupciones constantes comienza en las decisiones de arquitectura que se toman hoy.

Puntos Clave

SageMaker AI de AWS ha dado un paso técnico que tiene consecuencias estratégicas profundas para cualquier organización que opere modelos de inteligencia artificial en producción. La capacidad de reservar procesadores gráficos de la familia P y asignarlos directamente a endpoints de inferencia elimina la mayor fuente de incertidumbre en la operación de IA a escala: la disponibilidad de los recursos de cómputo. En iamanos.com, la agencia de inteligencia artificial número uno en México con estándares de Silicon Valley, llevamos esta capacidad directamente a la estrategia de nuestros clientes. No se trata solo de saber que esta funcionalidad existe; se trata de implementarla correctamente, negociar los planes adecuados y construir arquitecturas que conviertan la infraestructura en una ventaja competitiva real. Si tu organización está lista para dejar de improvisar con cómputo bajo demanda y comenzar a operar inteligencia artificial con la solidez que un producto de clase mundial requiere, es momento de hablar con nuestros expertos.

Lo que necesitas saber

Es un servicio web desplegado en la infraestructura de AWS que recibe solicitudes de predicción, ejecuta el modelo de inteligencia artificial y devuelve los resultados en tiempo real. En términos prácticos, es el componente que conecta tu aplicación con el modelo de IA que procesa las solicitudes de tus usuarios finales.

Un plan de entrenamiento en SageMaker AI es originalmente un acuerdo de capacidad diseñado para asegurar recursos durante fases de entrenamiento de modelos, que son intensivas en cómputo y de duración determinada. La novedad que AWS introduce es que esa misma capacidad reservada puede redirigirse a endpoints de inferencia, que son servicios continuos de producción, aprovechando así la infraestructura contratada en ambas fases del ciclo de vida del modelo.

AWS ofrece las instancias P3, P4 y P5 en su plataforma SageMaker AI. Las instancias P5, que incorporan los aceleradores de última generación, son las más adecuadas para modelos de gran escala y cargas de trabajo de inferencia con requisitos de latencia extremadamente bajos. La elección específica depende del tamaño del modelo, el volumen de solicitudes y los requisitos de latencia de cada caso de uso.

La capacidad reservada es la opción correcta cuando la carga de trabajo de inferencia tiene un patrón predecible, requiere disponibilidad constante y forma parte de un producto o servicio crítico de negocio. Si el volumen de solicitudes es altamente variable o el servicio puede tolerar interrupciones ocasionales, las instancias bajo demanda pueden ser más eficientes desde el punto de vista de costos. Para la mayoría de los productos de inteligencia artificial en producción madura, se recomienda una arquitectura híbrida con capacidad base reservada.

Sí. AWS SageMaker AI opera globalmente y las funcionalidades de planes de entrenamiento con capacidad reservada para inferencia están disponibles para clientes en todas las regiones donde AWS ofrece instancias de la familia P. Las empresas en México pueden acceder a esta infraestructura a través de las regiones más cercanas y en iamanos.com podemos asesorarte sobre la configuración óptima para tu caso de uso específico.

El impacto en costos depende de la comparación entre el precio de la capacidad reservada y lo que la organización pagaría en instancias bajo demanda con su patrón de uso actual. Para cargas de trabajo de alta utilización y disponibilidad constante, la capacidad reservada típicamente reduce el costo total entre un 20% y un 40% comparado con instancias bajo demanda. Adicionalmente, elimina los costos ocultos asociados a interrupciones de servicio, redespligues de emergencia y penalizaciones por incumplimiento de acuerdos de nivel de servicio.

IAmanos · Agencia de Inteligencia Artificial

Implementa IA en tu empresa este mes

Desde automatización hasta agentes autónomos. Cotiza gratis y recibe propuesta en 24h.

Convierte este conocimiento en resultados

Nuestro equipo implementa soluciones de IA para empresas B2B. Agenda una consultoría gratuita.